Чем агент отличается от помощника

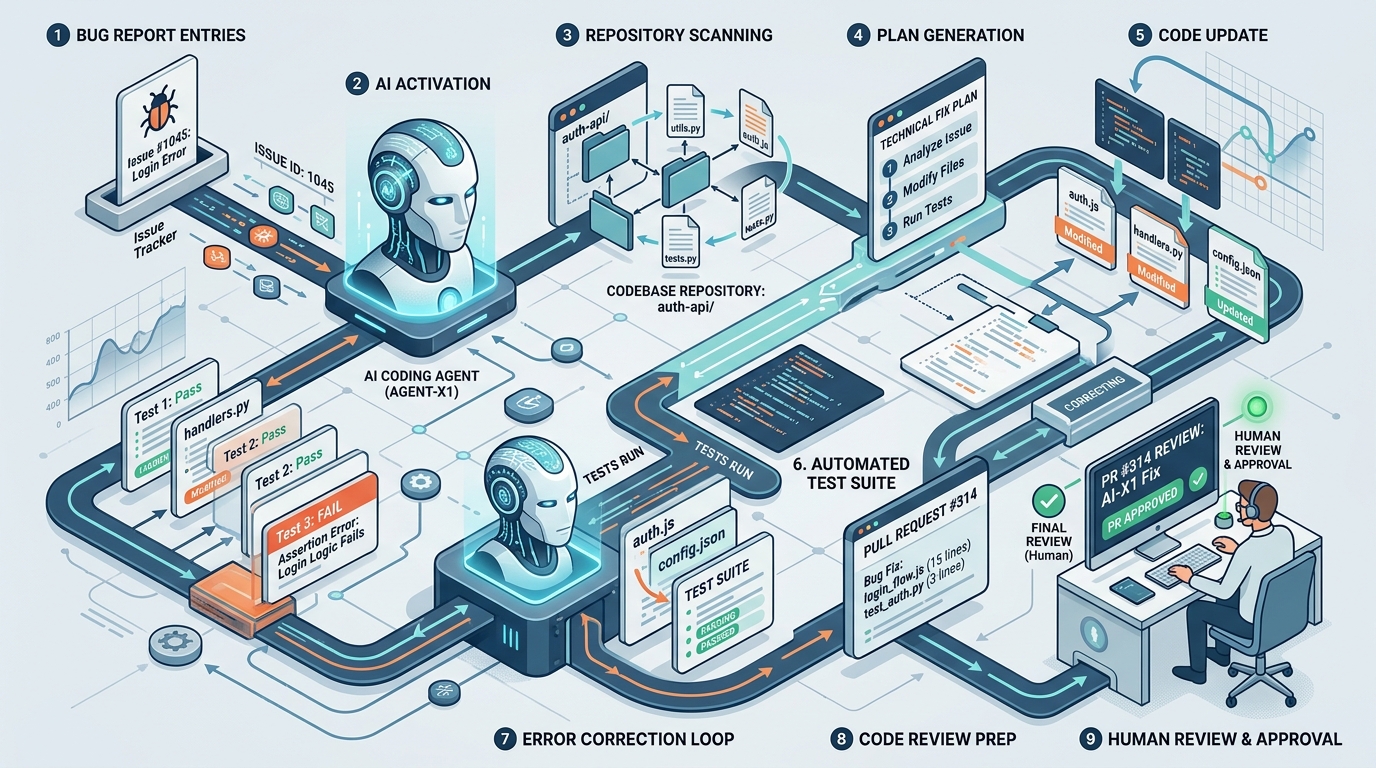

Разница между помощником и агентом проходит не по маркетинговому названию, а по устройству работы. Помощник отвечает в одном сообщении: объясняет, подсказывает, генерирует кусок кода, но дальше мяч снова на стороне человека. Агент устроен иначе. Он получает цель, читает контекст, планирует шаги, вызывает инструменты, проверяет результат и при необходимости сам же исправляет первую неудачную попытку.

Поэтому доступ к инструментам часто важнее условного интеллекта модели. Автодополнение может ускорять печать. Чат-помощник может сэкономить время на разборе. Но именно агент способен пройти связку из нескольких действий подряд. Например, получить баг-репорт, найти затронутый модуль, добавить регрессионный тест, поменять логику и подготовить объяснение diff для review. Это уже не ответ, а кусок завершённой работы.

Ссылки на источники

- Anthropic различает workflows и agents: первые лучше подходят для предсказуемых задач, вторые — когда системе нужно принимать решения по ходу выполнения.

- GitHub описывает coding agent как систему, которая принимает задачу, сама меняет код и открывает pull request на ревью.

- OpenAI в Agents SDK и guides по tools описывает агентный режим как связку модели с инструментами и трассировкой шагов.

Что они уже умеют закрывать

Сегодняшние агенты хорошо чувствуют себя на задачах, где много механики и достаточно ясный контекст. Локальные исправления багов, обновление тестов, рефакторинг в нескольких файлах, подготовка migration notes, changelog и описаний для pull request. В этих сценариях человек тратил время не на великие решения, а на последовательное прохождение шагов. Именно эту последовательность агент и умеет замыкать на себе.

Но важно не путать успешную демонстрацию с универсальностью. Сценарий сделай онбординг лучше для агента почти бесполезен, если в системе нет продуктовой модели результата. Он принесёт много изменений, но не сможет доказать, что действительно улучшил путь пользователя. То есть агент уже умеет быть сильным исполнителем, но только там, где задача сформулирована в терминах проверяемого выхода, а не размытого пожелания.

Ссылки на источники

- OpenAI перечисляет среди рабочих сценариев исправление багов, написание тестов, рефакторинг, ответы по кодовой базе и подготовку изменений для интеграции.

- GitHub указывает, что coding agent может исследовать репозиторий, изменять несколько файлов, запускать тесты и линтеры и итерировать по комментариям в PR.

Где проходит жёсткая граница

Граница появляется там, где задача опирается на неявную бизнес-логику, конфликт интересов внутри системы или длинный хвост скрытых зависимостей. Старый проект с сюрпризами, спорные архитектурные компромиссы, участки, где ошибка вылезает только под нагрузкой, задачи с высокой ценой регресса. Здесь агент может пройти половину пути очень уверенно и именно этим быть опасен: он создаёт впечатление, что ситуация под контролем, хотя реального понимания системы у него нет.

Хороший практический критерий такой: если задачу можно описать как набор артефактов, шагов и проверок, агент уже полезен. Если задача требует договориться о смысле, расставить приоритеты между несовместимыми вариантами или защитить архитектурный инвариант, агент остаётся помощником при инженере, а не его заменой.

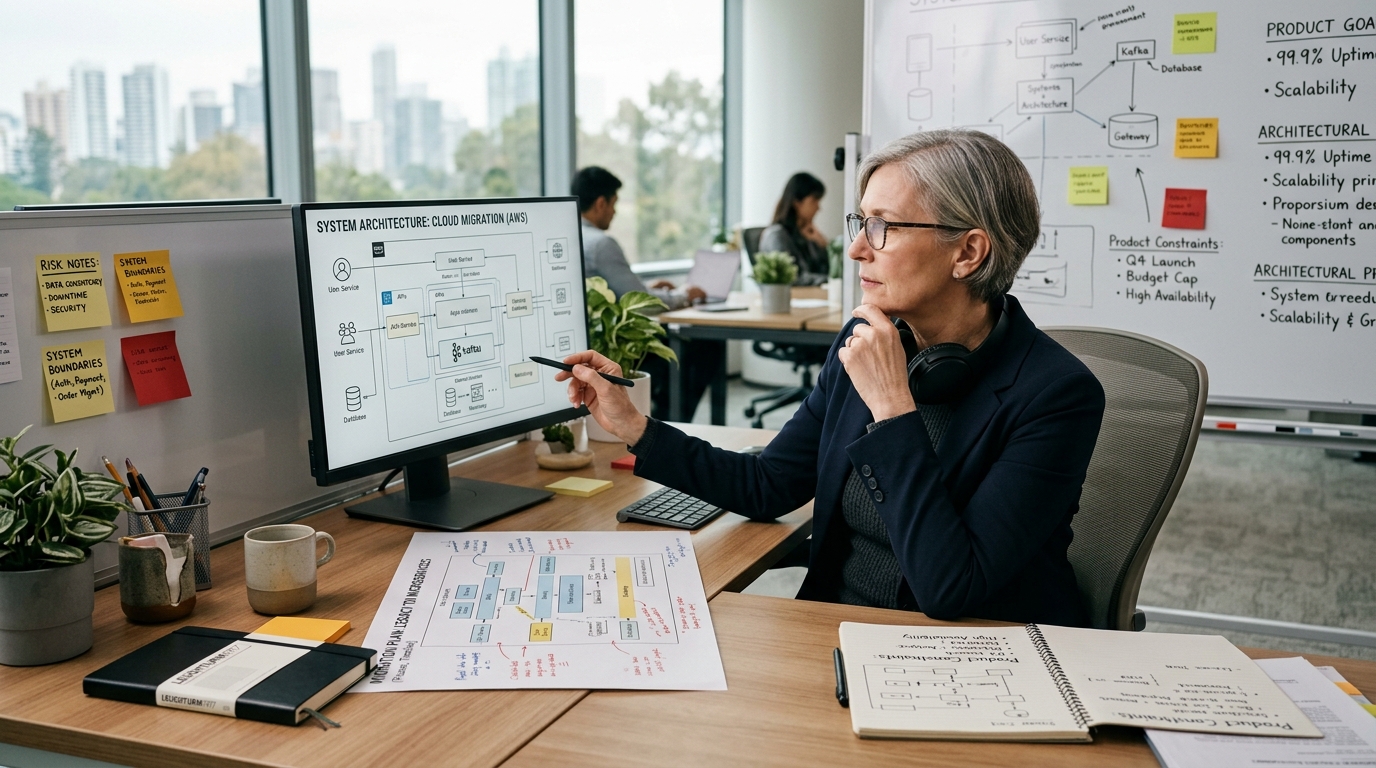

Что нужно команде

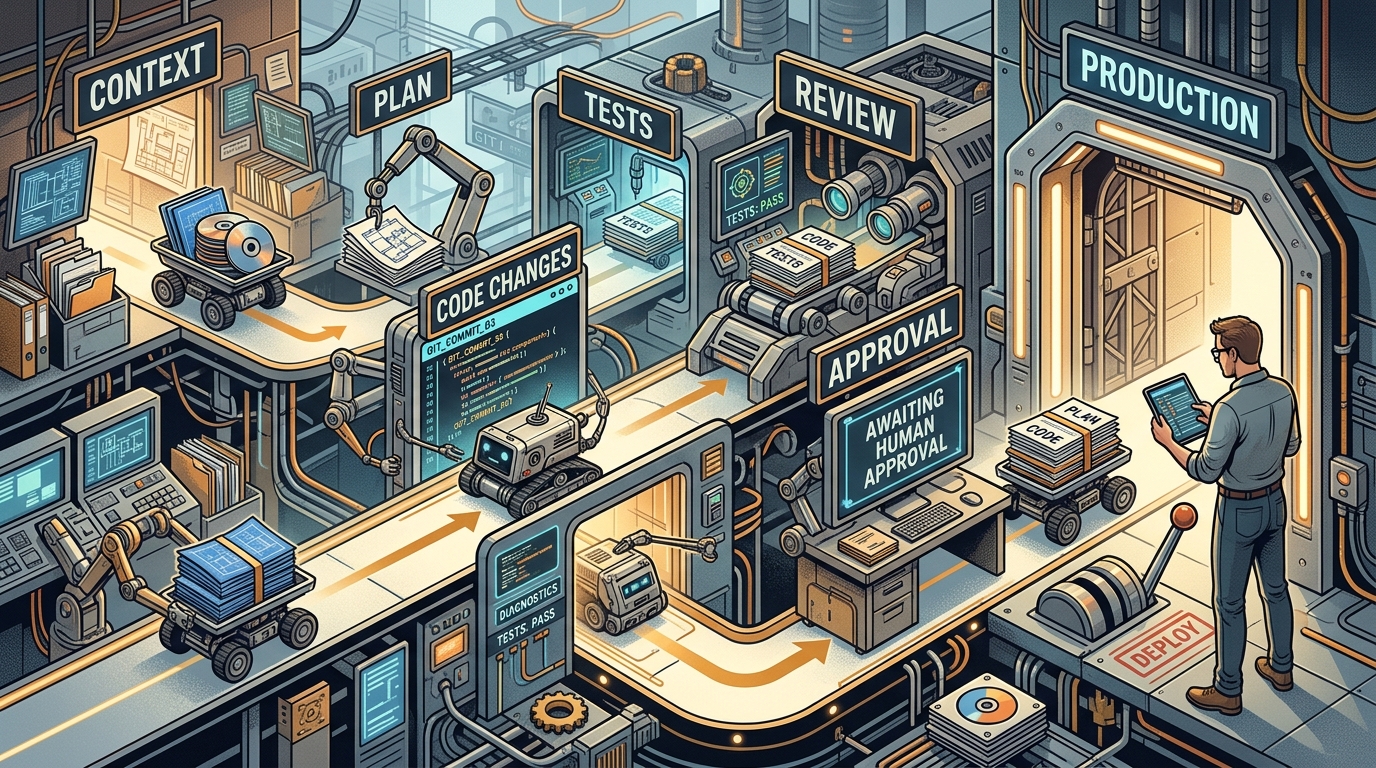

Полезность агента определяется не только моделью, но и средой. Ему нужен доступ к репозиторию, тестам, линтеру, песочнице, журналу действий и понятной системе прав. Причём ограниченные права почти всегда лучше полного доступа. Команда выигрывает не от того, что агенту дали всё, а от того, что каждое его действие можно объяснить, повторить и при необходимости быстро откатить.

Отсюда меняется и рабочий процесс. Часть задач лучше ставить не как текст тикета, а как намерение с критериями приёмки. Review не исчезает, а становится строже: теперь нужно проверять не только код, но и цепочку решений, по которой агент к нему пришёл. В этом смысле агент не заменяет инженера. Он автоматизирует кусок конвейера и делает особенно заметной цену плохой постановки задачи.

Ссылки на источники

- OpenAI описывает отдельные инструменты, которые расширяют возможности модели: web search, file search, code interpreter, computer use и remote MCP.

- GitHub документирует изолированную среду, ограничения на запуск workflow, политики организации и обязательный человеческий контроль для coding agent.

- Anthropic связывает полезность агента не только с моделью, но и с устройством всей системы вокруг него: простотой, наблюдаемостью и предсказуемостью контура.

Вывод

AI-агент полезен не тогда, когда красиво пишет код, а когда может безопасно закрыть ограниченный участок инженерного цикла. Без репозитория, тестов, ограниченных прав и обязательной проверки человеком агент остаётся не автоматизацией, а красиво оформленным риском.